Estamos no meio de um turbilhão tecnológico que transformará o modo como a sociedade é organizada. Precisamos tomar as decisões certas agora.

Traduzido da Scientific American, artigo original aqui.

“Iluminação é a rebeldia do homem contra a imaturidade que ele impõe a si mesmo. Imaturidade é a incapacidade do homem usar seu próprio entendimento sem a orientação do outro.

—Immanuel Kant, “O que é Iluminação?” (1784)

A revolução digital se encontra em pleno andamento. Como ela irá mudar nosso mundo? A quantidade de dados que produzimos duplica a cada ano. Em outras palavras: em 2016 nós produzimos a mesma quantidade de dados que em toda a história da humanidade até 2015. A cada minuto nós produzimos centenas de milhares de pesquisas do Google e postagens no Facebook. Estes contêm informações que revelam como pensamos e sentimos. Em breve, as coisas ao nosso redor, possivelmente até mesmo nossa roupa, também será conectada pela Internet. Estima-se que dentro de 10 anos haverá 150 bilhões de sensores de medição em rede, 20 vezes mais do que as pessoas na Terra. Em seguida, a quantidade de dados dobrará a cada 12 horas. Muitas empresas já estão tentando transformar essa enorme quantidade de dados em uma enorme quantidade de dinheiro.

Tudo se tornará inteligente. Em breve não teremos apenas telefones inteligentes, mas também casas inteligentes, fábricas inteligentes e cidades inteligentes. Devemos esperar que esses desenvolvimentos também resultem em nações inteligentes e um planeta mais inteligente?

O campo da inteligência artificial certamente está atingindo avanços de tirar o fôlego. Em particular, está contribuindo para a automatização da análise de dados. Inteligência artificial não é mais programada linha por linha, mas agora é capaz de aprender, continuamente se desenvolvendo. Recentemente, o algoritmo DeepMind do Google ensinou a si mesmo como ganhar 49 jogos Atari.

Algoritmos podem agora reconhecer linguagem manuscrita e padrões quase tão bem quanto seres humanos e até mesmo completar algumas tarefas melhor do que eles. Elas são capazes de descrever o conteúdo de fotos e vídeos. Hoje 70% de todas as transações financeiras são realizadas por algoritmos. O conteúdo de notícias é, em parte, gerado automaticamente. Tudo isso tem conseqüências econômicas radicais: nos próximos 10 a 20 anos, cerca de metade dos empregos atuais serão ameaçados por algoritmos. 40% das 500 maiores empresas de hoje terão desaparecido na próxima década.

É esperado que supercomputadores em breve possam superar as capacidades humanas em quase todas as áreas, algo previsto pra ocorrer entre 2020 e 2060. Especialistas estão começando a soar alarmes. Visionários da tecnologia, como Elon Musk da Tesla Motors, Bill Gates da Microsoft e o co-fundador da Apple, Steve Wozniak, estão alertando que a superinteligência é um sério perigo para a humanidade, possivelmente ainda mais perigoso que armas nucleares. Isso é alarmismo?

Uma coisa é clara: a forma como organizamos a economia e a sociedade mudará fundamentalmente. Estamos experimentando a maior transformação desde o fim da Segunda Guerra Mundial. Após a automação da produção e a criação de condução automática de carros, a automação da sociedade é o próximo passo. Com isso, a sociedade se encontra em uma encruzilhada, o que promete grandes oportunidades, mas também riscos consideráveis. Se tomarmos as decisões erradas, isso pode até mesmo ameaçar nossas maiores realizações históricas.

Na década de 1940, o matemático americano Norbert Wiener (1894-1964) inventou a cibernética. Segundo ele, o comportamento de sistemas poderia ser controlado por meio da especificação de um sistema de retroalimentação de dados (feedbacks). Muito em breve, imaginavam alguns pesquisadores, seria possível controlar a economia e a sociedade de acordo com este princípio básico, mas a tecnologia necessária não estava disponível na época

Atualmente, Cingapura é vista como o exemplo perfeito de uma sociedade controlada por dados. O que começou como um programa para proteger seus cidadãos do terrorismo acabou por influenciar a política econômica e de imigração, o mercado imobiliário e os currículos escolares. A China está seguindo um caminho semelhante. Recentemente, o Baidu, o equivalente chinês do Google, convidou os militares a participar do Projeto Cérebro da China (China Brain Project).

O projeto envolve executar os chamados algoritmos de aprendizagem profunda (Deep Learning) sobre dados de busca coletados de seus usuários. Além disso, também está planejada uma espécie de controle social. De acordo com relatórios recentes, cada cidadão chinês receberá a chamada “Pontuação de Cidadão”, que irá determinar em que condições eles poderão obter empréstimos, empregos ou vistos de viagem para outros países. Este tipo de monitoramento individual incluiria a navegação na Internet das pessoas e o comportamento de seus contatos sociais (veja “Destaque na China”).

Com os consumidores enfrentando verificações de crédito cada vez mais frequentes e algumas lojas online experimentando com preços personalizados, estamos em um caminho semelhante no Ocidente. Também é cada vez mais claro que estamos todos no centro de uma vigilância institucional. Isto foi revelado em 2015 quando os detalhes do programa do serviço secreto britânico “Karma Police” se tornaram públicos, mostrando uma abrangente triagem da navegação de todas as pessoas na Internet. O Big Brother agora está se tornando uma realidade? Sociedade programada, cidadãos programados

Tudo começou de maneira bastante inofensiva. Plataformas de busca e sites de recomendação começaram a oferecer sugestões personalizadas de produtos e serviços. Esta informação é baseada em dados pessoais e meta-dados que foram recolhidos de pesquisas anteriores, compras e comportamento de mobilidade, bem como interações sociais. Enquanto oficialmente, a identidade do usuário é protegida, ela pode, na prática, ser descoberta com bastante facilidade.

Hoje, os algoritmos sabem muito bem o que fazemos, o que pensamos e como nos sentimos – possivelmente até melhor do que nossos amigos e familiares ou até nós mesmos. Muitas vezes as recomendações que nos são oferecidas se encaixam tão bem que as decisões resultantes se sentem como se fossem nossas, mesmo que elas não sejam realmente nossas próprias decisões. Na verdade, estamos sendo controlados remotamente cada vez mais com êxito desta maneira. Quanto mais se sabe sobre nós, menos provável é que nossas escolhas sejam livres e não predeterminadas por outros.

Mas não para por aí. Algumas plataformas de software estão se movendo em direção à chamada “computação persuasiva”. No futuro, usando sofisticadas tecnologias de manipulação, essas plataformas poderão nos guiar através de completas rotas de ação, seja para a execução de processos de trabalho complexos ou para gerar conteúdo gratuito para Plataformas na Internet, das quais as corporações ganham bilhões. A tendência passará de programar computadores para programar pessoas.

Essas tecnologias também estão se tornando cada vez mais populares no mundo da política. Sob o rótulo de nudging (’empurrãozinho’), e em grande escala, os governos estão tentando orientar os cidadãos para um comportamento mais saudável ou mais ambientalmente amigável por meio de um nudging – uma forma moderna de paternalismo. Esse novo governo que se preocupa não está apenas interessado no que fazemos, mas também quer certificar-se de que fazemos as coisas da maneira que consideram ser a mais correta. A expressão mágica é big nudging (grande empurrãozinho), o que implica na combinação de Big Data com cutucadas. Para muitos, isso parece ser uma espécie de cetro digital que permite governar as massas de maneira eficiente, sem ter que envolver os cidadãos em processos democráticos. Isso poderia afetar direitos adquiridos e otimizar o curso do mundo? Se assim for, então os cidadãos poderiam ser governados por um poderoso “rei sábio”, que seria capaz de produzir resultados econômicos e sociais desejados quase como com uma varinha mágica digital. Catástrofes pré-programadas.

Mas uma análise sobre a literatura científica relevante mostra que as tentativas de controlar as opiniões, no sentido de sua “otimização”, estão condenadas a falhar devido à complexidade do problema. A dinâmica da formação de opiniões é cheia de surpresas. Ninguém sabe como a varinha mágica digital, ou seja, a técnica manipuladora de cutucadas deveria ser melhor utilizada. O que teria sido a maneira certa ou errada muitas vezes só é aparente depois. Durante a epidemia da gripe suína em 2009, por exemplo, todos foram encorajados a ir para vacinação. No entanto, sabemos agora que um certo percentual dos que receberam a imunização foram afetados por uma doença incomum, a narcolepsia. Felizmente, não havia muitas pessoas optando por se vacinar!

Outro exemplo é a recente tentativa de planos de saúde de incentivar exercício físico, distribuindo pulseiras fitness inteligentes, com o objetivo de reduzir a quantidade de doenças cardiovasculares na população. Mas, no final, isso pode resultar em mais operações de coluna. Em um sistema complexo, como a sociedade, uma melhoria em uma área quase inevitavelmente leva à deterioração em outra. Assim, intervenções em larga escala podem por vezes se mostrar como enormes erros.

Independentemente disso, criminosos, terroristas e extremistas tentarão e conseguirão assumir o controle da varinha mágica digital mais cedo ou mais tarde – talvez até mesmo sem percebermos. Quase todas as empresas e instituições já foram hackeadas, até mesmo o Pentágono, a Casa Branca e a NSA.

Um outro problema ocorre quando falta transparência e controle democrático: a erosão do sistema por dentro. Algoritmos de busca e sistemas de recomendação podem ser influenciados. As empresas podem vincular determinadas combinações de palavras para obter resultados mais favoráveis. Governos provavelmente são capazes de influenciar resultados também. Durante as eleições, eles podem induzir eleitores indecisos a apoiá-los – uma manipulação que seria difícil de detectar.

Portanto, quem controla esta tecnologia pode ganhar as eleições – ao levar a si mesmo ao poder.

Este problema é exacerbado pelo facto de que, em muitos países, um único motor de busca ou plataforma de mídia social tem uma quota de mercado predominante. Poderia influenciar decisivamente o público e interferir com esses países remotamente. Embora o acórdão do Tribunal de Justiça Europeu de 6 de Outubro de 2015 limite a exportação ilimitada de dados europeus, o problema subjacente ainda não foi resolvido na Europa e menos ainda em outros países.

Que efeitos secundários indesejáveis podemos esperar? Para que a manipulação permaneça despercebida, é necessário o chamado efeito de ressonância – sugestões que sejam suficientemente personalizadas para cada indivíduo. Desta forma, tendências locais são gradualmente reforçadas por meio de repetição, direcionando para uma “bolha de filtro” ou “efeito de câmara de eco”: no final, tudo o que você vai conseguir é ter a sua opinião refletida de volta para você. Isso causa uma polarização social, resultando na formação de grupos segregados que não se entendem mais e entram cada vez mais em conflito uns com os outros. Desta forma, a informação personalizada pode destruir a coesão social por acidente. Isso pode ser observado atualmente na política americana, onde democratas e republicanos estão cada vez mais distanciados, de modo que os compromissos políticos se tornem quase impossíveis. O resultado é uma fragmentação e possivelmente até mesmo uma desintegração da sociedade.

Devido ao efeito ressonância, uma mudança de opinião em larga escala na sociedade só pode ser produzida lenta e gradualmente. Os efeitos ocorrem com um atraso, mas eles também não podem ser facilmente desfeitos. É possível, por exemplo, que o ressentimento contra as minorias ou os imigrantes fique fora de controle; Muito sentimento nacional pode causar discriminação, extremismo e conflito.

Talvez ainda mais significativo seja o fato de que métodos manipulatórios mudam a maneira como tomamos nossas decisões. Eles anulam referências culturais e sociais que antes eram relevantes, pelo menos temporariamente. Em resumo, o uso em larga escala de métodos manipulatórios poderia causar sérios danos sociais, incluindo a brutalização do comportamento no mundo digital. Quem deve ser responsabilizado por isso?

Questões Legais

Isso levanta questões legais que, dada a enorme quantidade de multas contra Empresas de Tabaco, Bancos, Empresas de TI e de Automóveis nos últimos anos, não devem ser ignoradas. Mas que leis, se houver alguma, poderiam ser violadas? Em primeiro lugar, está claro que essas tecnologias manipulatórias restringem a liberdade de escolha. Se um controle remoto de nosso comportamento funcionasse perfeitamente, seríamos essencialmente escravos digitais, porque nós só executaríamos decisões que fossem decididas por outros antes. É claro que essas tecnologias manipuladoras são apenas parcialmente eficazes. No entanto, nossa liberdade está desaparecendo lentamente, mas de maneira definitiva – de fato, lentamente o suficiente para que tenha havido pouca resistência por parte da população, até agora.

As idéias do grande Iluminista Immanuel Kant parecem ser altamente relevantes aqui. Entre outras coisas, ele observou que um Estado que tenta determinar a felicidade de seus cidadãos é um déspota. No entanto, o direito de auto-desenvolvimento individual só pode ser exercido por aqueles que têm controle sobre suas vidas, o que pressupõe auto-determinação informacional. Trata-se de nada menos do que os nossos mais importantes direitos constitucionais. Uma democracia não pode funcionar bem se esses direitos não forem respeitados. Se eles são constrangidos, isso mina nossa constituição, nossa sociedade e o Estado.

Já que tecnologias de manipulação como Big Nuding funcionam de maneira semelhante à publicidade personalizada, outras leis serão afetadas também. Publicidade deve ser marcada como tal, para não induzir ao erro. Eles também não são autorizados a utilizar certos truques psicológicos, tais como estímulos subliminares. É por isso que é proibido mostrar um refrigerante em um filme por uma fração de segundo, porque então a publicidade não é conscientemente perceptível, enquanto ele ainda pode ter um efeito subconsciente. Além disso, a atual coleta e tratamento generalizado de dados pessoais não é certamente compatível com as leis aplicáveis em matéria de proteção de dados nos países europeus e outros países.

Finalmente, a legalidade de preços personalizados é questionável, porque poderia ser classificado como um uso indevido de informações privilegiadas. Outros aspectos relevantes são a possível violação dos princípios da igualdade e da não discriminação – e das leis de concorrência, uma vez que o livre acesso ao mercado e a transparência dos preços já não estão garantidos. A situação é comparável às empresas que vendem seus produtos mais baratos em outros países, mas que tentam evitar compras nesses países. Tais casos resultaram em multas punitivas elevadas no passado.

Publicidade personalizada e preços não podem ser comparados com publicidade clássica ou cupons de desconto, como estes últimos não são específicos e também não invadem a nossa privacidade com o objetivo de tirar proveito de nossas fraquezas psicológicas e nocautear nosso pensamento crítico.

Além disso, não esqueçamos que, no mundo acadêmico, até experiências inofensivas de decisão são consideradas experiências com seres humanos, que teriam de ser aprovadas por um comitê de ética publicamente responsável. Em todos os casos, as pessoas envolvidas devem dar o seu consentimento informado. Em contrapartida, um único clique para confirmar que concordamos com o conteúdo de um contrato de “termos de uso” de cem páginas (que é o caso atualmente para muitas plataformas de informação) é lamentavelmente inadequado.

Ainda assim, experimentos com tecnologias manipulativas, como nudging, são realizados com milhões de pessoas, sem informá-las, sem transparência e sem restrições éticas. Mesmo grandes redes sociais como o Facebook ou plataformas de namoro online como OkCupid já admitiram publicamente a realização deste tipo de experiências sociais. Se quisermos evitar pesquisas irresponsáveis sobre os seres humanos e sobre a sociedade (basta pensar no envolvimento de psicólogos em escândalos de tortura recentemente), então precisamos urgentemente impor padrões elevados, especialmente critérios científicos de qualidade e um código de conduta semelhante ao Juramento de Hipócrates. Será que o nosso pensamento, nossa liberdade e nossa democracia foi cortada?

Vamos supor que existisse uma máquina super-inteligente com conhecimento divino e habilidades sobre-humanas: seguiríamos suas instruções? Isso parece possível. Mas se fizéssemos isso, então as advertências expressas por Elon Musk, Bill Gates, Steve Wozniak, Stephen Hawking e outros seriam verdadeiras: os computadores teriam tomado o controle do mundo. Devemos estar certos de que uma superinteligência também poderia cometer erros, mentir, buscar interesses egoístas ou ser manipulada. Acima de tudo, não podia ser comparada com a inteligência coletiva distribuída de toda a população.

A ideia de substituir o pensamento de todos os cidadãos por um cluster de computadores seria absurda, porque isso reduziria dramaticamente a diversidade e qualidade das soluções possíveis. Já está claro que os problemas do mundo não diminuíram apesar da recente inundação de dados e do uso de informações personalizadas – pelo contrário! A paz mundial é frágil. A mudança de longo prazo no clima pode levar à maior perda de espécies desde a extinção dos dinossauros. Também estamos longe de ter superado a crise financeira e o seu impacto na economia. É estimado que cibercrimes possam causar uma perda anual de 3 trilhões de dólares. Estados e terroristas estão se preparando para a guerra cibernética.

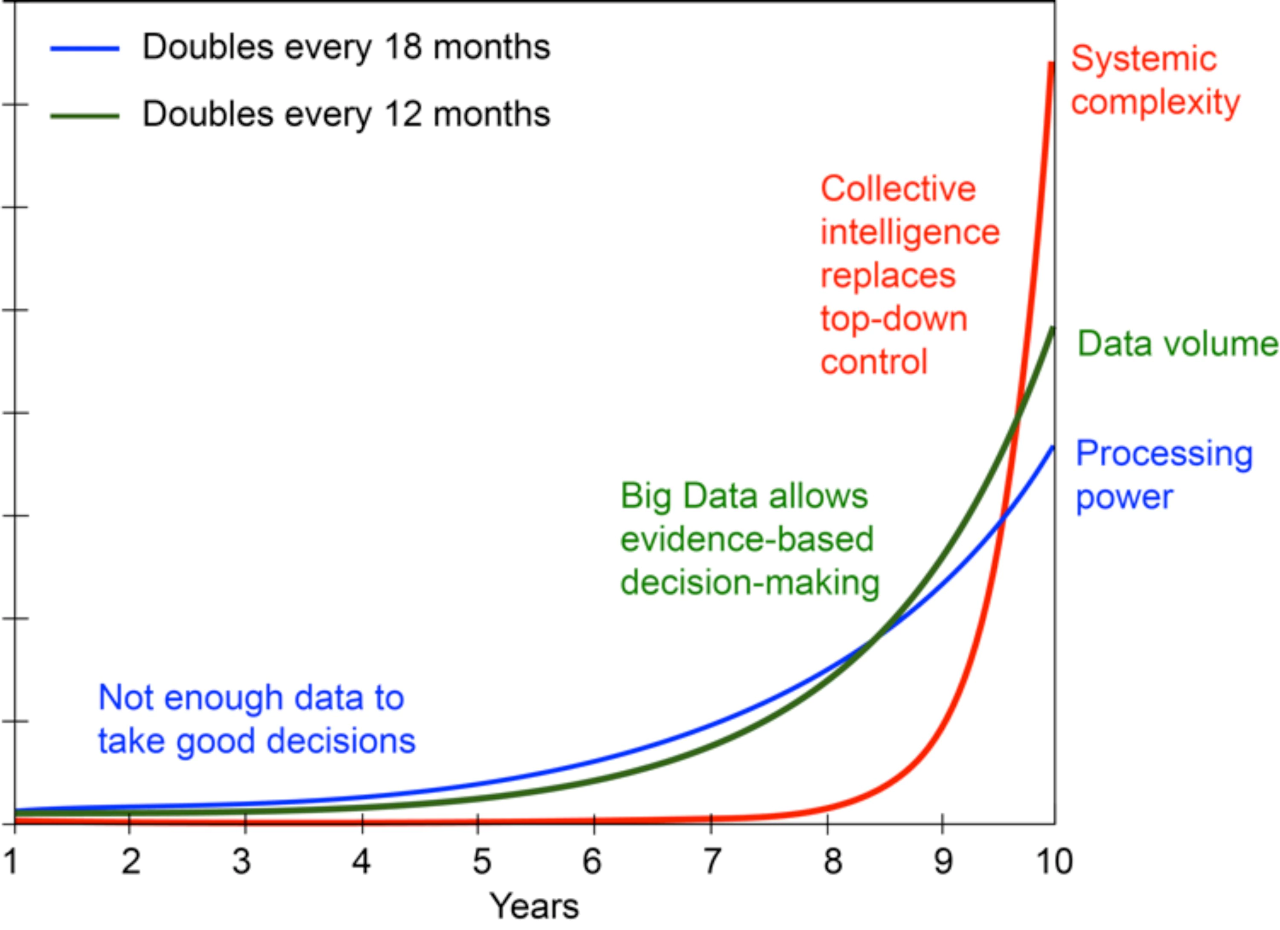

Em um mundo em rápida mutação, uma superinteligência nunca pode tomar decisões perfeitas (ver figura 1): a complexidade sistêmica está aumentando mais rápido do que os volumes de dados, que por sua vez estão crescendo mais rápido do que a capacidade de processá-los e as taxas de transferência de dados são limitadas. Isso resulta em desconsiderar o conhecimento local e fatos, que são importantes para alcançar boas soluções. Distribuídos, os métodos de controle local são geralmente superiores às abordagens centralizadas, especialmente em sistemas complexos cujos comportamentos são altamente variáveis, dificilmente previsíveis e não capazes de otimização em tempo real. Isso já é verdade para o controle de tráfego nas cidades, mas ainda mais para os sistemas sociais e econômicos de nosso mundo altamente interligado e globalizado.

Além disso, há o perigo de que a manipulação de decisões por poderosos algoritmos minem a base da “inteligência coletiva”, a qual pode se adaptar de maneira flexível aos desafios do nosso mundo complexo. Para que a inteligência coletiva funcione, as buscas de informações e a tomada de decisões por indivíduos devem ocorrer de forma independente. Se nossos julgamentos e decisões são predeterminados por algoritmos, no entanto, isso realmente leva a uma lavagem cerebral das pessoas. Os seres inteligentes são rebaixados para meros receptores de comandos, que respondem automaticamente aos estímulos.

Em outras palavras: a informação personalizada constrói uma “filtro de bolha” ao nosso redor, uma espécie de prisão digital para o nosso pensamento. Como poderia a criatividade e o pensamento “fora da caixa” ser possível sob tais condições? Em última análise, um sistema centralizado de controle tecnológico e social de controle usando um sistema de informação super-inteligente resultaria em uma nova forma de ditadura. Portanto, a sociedade controlada de cima para baixo, que vem sob a bandeira do “paternalismo liberal”, é em princípio nada mais do que um regime totalitário com uma capa rosada.

Na verdade, esse ’big nudging’ visa trazer as ações de muitas pessoas para alinhar e manipular suas perspectivas e decisões. Isso a coloca na arena da propaganda e da incapacidade direcionada do cidadão pelo controle comportamental. Esperamos que as consequências sejam fatais a longo prazo, especialmente quando se considera o efeito acima mencionado de minar a cultura. É possível uma melhor sociedade digital

Apesar da feroz competição global, seria mais prudente por parte das democracias que as mesmas não joguem ao mar conquistas obtidas ao longo de muitos séculos. Em contraste com outros regimes políticos, as democracias ocidentais têm a vantagem de terem aprendido a lidar com o pluralismo e a diversidade. Agora eles só têm que aprender a capitalizar mais sobre eles.

No futuro, esses países irão atingir a um equilíbrio saudável entre empresas, governo e cidadãos. Isso requer um pensamento em rede e o estabelecimento de um “ecossistema” de informação, inovação, produto e serviço. Para funcionar bem, não só é importante criar oportunidades de participação, mas também apoiar a diversidade. Porque não há maneira de determinar a melhor função meta: devemos otimizar o produto nacional bruto per capita ou sustentabilidade? Poder ou paz? Felicidade ou expectativa de vida? Muitas vezes, o que teria sido melhor só é conhecido após o fato. Permitindo a prossecução de vários objetivos diferentes, uma sociedade pluralista é mais capaz de lidar com a gama de desafios inesperados por vir.

O controle centralizado de cima para baixo é uma solução do passado, que só é adequada para sistemas de baixa complexidade. Portanto, sistemas federativos e as decisões majoritárias são as soluções do presente. Com a evolução econômica e cultural, a complexidade social continuará a crescer. Portanto, a solução para o futuro é a inteligência coletiva. Isto significa que a ciência do cidadão, o financiamento coletivo e as plataformas de discussão online são abordagens eminentemente importantes para gerar mais conhecimento, idéias e recursos disponíveis.

Inteligência coletiva requer um alto grau de diversidade. Isso implica, no entanto, em reduzir os sistemas de informação personalizados de hoje, os quais reinforçam tendências.

A sociodiversidade é tão importante quanto a biodiversidade. Ela alimenta não apenas a inteligência coletiva e a inovação, mas também a resiliência – a capacidade de nossa sociedade de lidar com choques inesperados. Reduzir a sociodiversidade muitas vezes também reduz a funcionalidade e o desempenho de uma economia e da sociedade. Esta é a razão pela qual regimes totalitários muitas vezes acabam em conflito com seus vizinhos. As consequências típicas a longo prazo são a instabilidade política e a guerra, como aconteceu uma e outra vez ao longo da história. O pluralismo e a participação não devem, portanto, ser vistos principalmente como concessões aos cidadãos, mas como pré-requisitos funcionais para sociedades modernas prósperas, complexas.

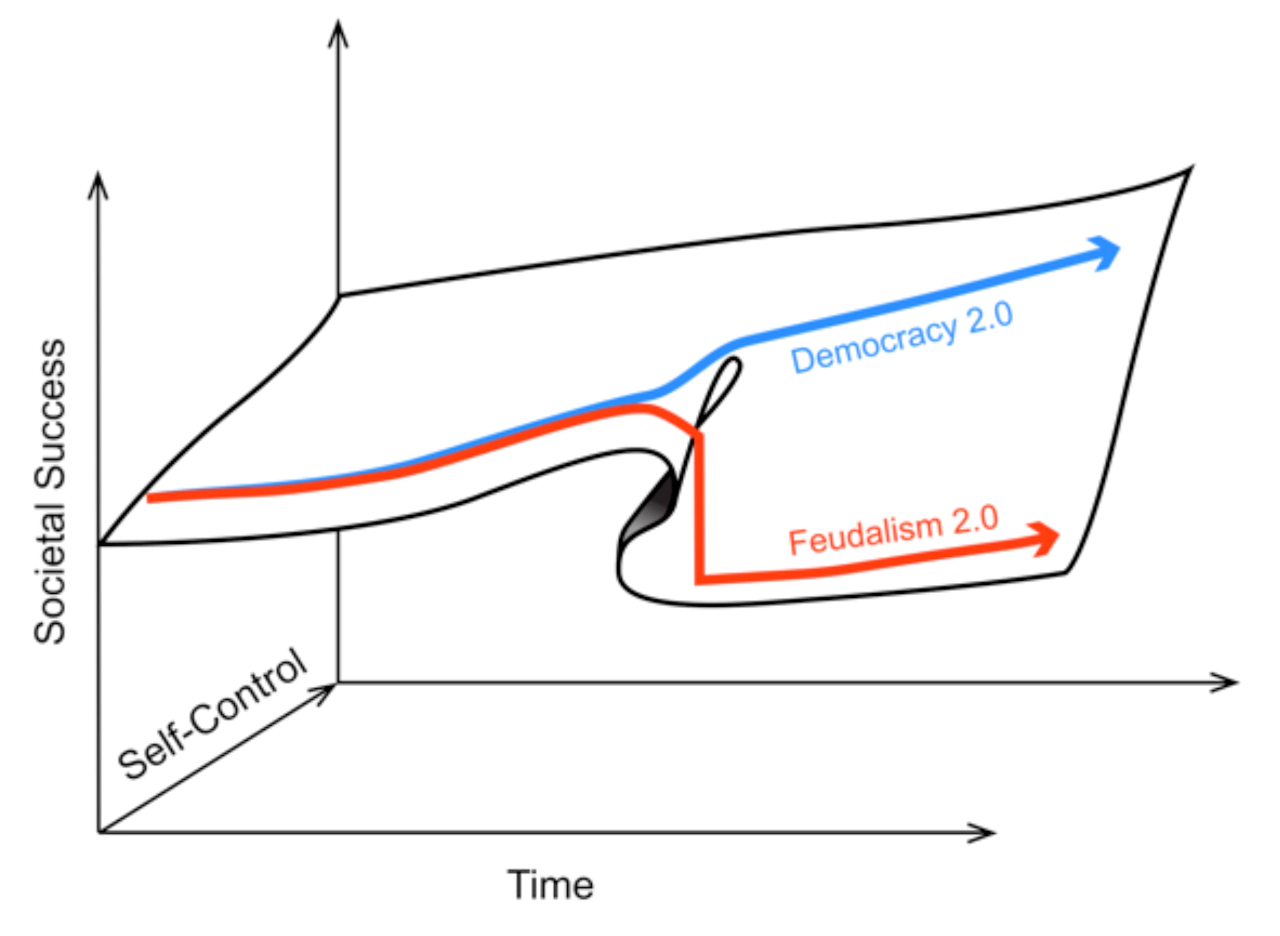

Em resumo, pode-se dizer que estamos agora numa encruzilhada (ver Fig. 2). Grande quantidade de dados, inteligência artificial, cibernética e economia comportamental estão moldando nossa sociedade – para melhor ou pior. Se tais tecnologias generalizadas não são compatíveis com os valores centrais da nossa sociedade, mais cedo ou mais tarde eles causarão danos extensos, podendo levar a uma sociedade automatizada com características totalitárias. No pior caso, uma inteligência centralizada artificial controlaria o que sabemos, o que pensamos e como agimos. Estamos no momento histórico, onde temos de decidir o caminho certo – um caminho que nos permita se beneficiar da revolução digital. Por isso, insistimos em aderir aos seguintes princípios fundamentais:

1. Descentralizar cada vez mais a função dos sistemas de informação,

2. Apoiar a autodeterminação e a participação informativa,

3. melhorar a transparência a fim de obter uma maior confiança,

4. reduzir a distorção e a poluição da informação,

5. Permitir filtros de informação controlados pelo utilizador,

6. Apoiar a diversidade social e econômica,

7. Melhorar a interoperabilidade e as oportunidades de colaboração,

8. Criar assistentes digitais e ferramentas de coordenação,

9. apoiar a inteligência coletiva, e

10. Promover um comportamento responsável dos cidadãos no mundo digital através da alfabetização digital e do esclarecimento.

Seguindo essa agenda digital, todos nós seremos beneficiados com os frutos da revolução digital: a economia, o governo e os cidadãos. O que estamos esperando? Uma estratégia para a era digital. Big Data e Inteligência Artificial são indubitavelmente inovações importantes. Elas tem um enorme potencial para catalisar o valor econômico e o progresso social, de saúde personalizada para cidades sustentáveis.

No entanto, é totalmente inaceitável usar essas tecnologias para incapacitar o cidadão. Big Nudging e ’Pontuação de Cidadão’ abusam de dados pessoais recolhidos de maneira centralizada para o controle comportamental em formas que são de natureza totalitária. Isto não é apenas incompatível com os direitos humanos e os princípios democráticos, mas também inadequado para gerir sociedades modernas e inovadoras. A fim de resolver os verdadeiros problemas do mundo, são necessárias abordagens muito melhores nos domínios da informação e da gestão de riscos. A área de pesquisa de inovação responsável e a iniciativa “Dados para a Humanidade” (ver “Big Data para o benefício da sociedade e da humanidade” abaixo) fornecem orientação sobre como dados e inteligência artificial devem ser usados em benefício da sociedade.

O que podemos fazer agora? Em primeiro lugar, mesmo nestes tempos de revolução digital, os direitos fundamentais dos cidadãos devem ser protegidos, uma vez que são um pré-requisito fundamental de uma sociedade funcional e democrática moderna. Isto exige a criação de um novo contrato social, baseado na confiança e na cooperação, que considere os cidadãos e os clientes não como obstáculos ou recursos a serem explorados, mas como parceiros. Para isso, o Estado deveria providenciar um quadro regulatório adequado, que garanta que as tecnologias sejam concebidas e utilizadas de forma compatível com a democracia. Para isso será necessário garantir a autodeterminação informacional, não só teoricamente, mas também de maneira pratica, porque é uma condição prévia para que possamos conduzir nossas vidas de forma autodeterminada e responsável.

Deve haver também o direito de obter uma cópia dos dados pessoais coletados sobre nós. Deveria ser regulado por lei que essas informações devam ser enviadas automaticamente, em formato padronizado a um arquivo de dados pessoais através do qual os indivíduos poderiam gerenciar o uso de seus dados (potencialmente suportados por assistentes digitais específicos baseados em AI). Para garantir uma maior privacidade e prevenir a discriminação, a utilização não autorizada de dados deveria ser punível por lei. Os indivíduos seriam então capazes de decidir quem pode usar suas informações, com que finalidade e por quanto tempo. Além disso, devem ser tomadas medidas adequadas para garantir que os dados sejam seguramente armazenados e trocados.

Sistemas de reputação sofisticados considerando critérios múltiplos poderiam ajudar a aumentar a qualidade da informação em que nossas decisões são baseadas. Se os filtros de dados e os algoritmos de recomendação e pesquisa fossem selecionáveis e configuráveis pelo usuário, poderíamos examinar problemas de múltiplas perspectivas e seríamos menos propensos à manipulação por informações distorcidas.

Além disso, precisamos de um sistema de reclamações eficiente para os cidadãos, bem como sanções eficazes para violações das regras. Finalmente, a fim de criar transparência e confiança suficientes, as instituições científicas líderes devem atuar como orgãos de confiança dos dados e algoritmos que atualmente evitam o controle democrático. Isso exigiria também um código de conduta apropriado que, pelo menos, teria de ser seguido por qualquer pessoa com acesso a dados sensíveis e algoritmos – uma espécie de juramento hipocrático para profissionais de TI.

Além disso, exigiria uma agenda digital para lançar as bases para novos empregos e o futuro da sociedade digital. Todos os anos investimos bilhões no setor agrícola e infra-estrutura pública, escolas e universidades – em benefício da indústria e do setor de serviços

Que sistemas públicos precisamos, portanto, para garantir que a sociedade digital se torne um sucesso? Primeiro, são necessários conceitos educacionais completamente novos. Este deve ser mais centrado no pensamento crítico, criatividade, inventividade e empreendedorismo do que na criação de trabalhadores padronizados (cujas tarefas, no futuro, serão feitas por robôs e algoritmos de computador). A educação deve também proporcionar uma compreensão do uso responsável e crítico das tecnologias digitais, porque os cidadãos devem estar conscientes de como o mundo digital está entrelaçado com o físico. A fim de exercer de forma eficaz e responsável os seus direitos, os cidadãos devem ter uma compreensão destas tecnologias, mas também de quais de seus usos são ilegítimos. É por isso que há ainda mais necessidade de ciência, indústria, política e instituições educacionais para tornar esse conhecimento amplamente disponível.

Em segundo lugar, é necessária uma plataforma participativa que facilite o acesso das pessoas a trabalhadores independentes, que criem projetos próprios, encontrem parceiros de colaboração, comercializem produtos e serviços em todo o mundo, gerem recursos e paguem contribuições fiscais e de segurança social (uma espécie de economia de compartilhamento para todos). Para complementar isso, cidades e até mesmo aldeias poderiam criar centros para as comunidades digitais emergentes (como fablabs), onde as idéias podem ser desenvolvidas em conjunto e testadas gratuitamente. Graças à abordagem aberta e inovadora encontrada nesses centros, a inovação colaborativa maciça poderia ser promovida.

Alguns tipos particulares de competições poderiam fornecer incentivos adicionais para a inovação, ajudar a aumentar a visibilidade pública e gerar impulso para uma sociedade digital participativa. Elas podem ser particularmente úteis na mobilização da sociedade civil para assegurar contribuições locais para a resolução de problemas globais (por exemplo, através de “Jogos Olímpicos do Clima”). Por exemplo, as plataformas que visam coordenar recursos escassos poderiam ajudar a libertar o enorme potencial da economia circular e de partilha, que ainda é largamente inexplorada.

Com o compromisso de uma estratégia aberta de dados, os governos e a indústria disponibilizariam cada vez mais dados para ciência e uso público, criando condições adequadas para um ecossistema eficiente de informação e inovação que acompanhasse os desafios do nosso mundo. Isto poderia ser encorajado por reduções de impostos, da mesma forma que foram concedidos em alguns países para o uso de tecnologias ambientalmente amigáveis.

Em terceiro lugar, a construção de um “sistema nervoso digital”, gerido pelos cidadãos, poderia abrir novas oportunidades da Internet das Coisas para todos e fornecer medições de dados em tempo real disponíveis a todos. Se quisermos usar os recursos de forma mais sustentável e retardar a mudança climática, precisamos medir os efeitos colaterais positivos e negativos de nossas interações com os outros e com nosso ambiente. Usando laços de feedback apropriados, os sistemas podem ser influenciados de tal maneira que eles alcancem os resultados desejados por meio da auto-organização.

Para que isso funcione, precisaríamos de vários sistemas de incentivo e de troca, disponíveis para todos os inovadores econômicos, políticos e sociais. Isso poderia criar mercados inteiramente novos e, portanto, também a base para uma nova prosperidade. A liberalização do potencial virtualmente ilimitado da economia digital seria grandemente promovida por um sistema financeiro pluralista (por exemplo, moedas funcionalmente diferenciadas) e por novas regulamentações para a compensação das invenções.

Para que isso funcione, precisamos de vários sistemas de incentivo e de troca, disponíveis para todos os inovadores econômicos, políticos e sociais. Isso poderia criar mercados inteiramente novos e, portanto, também a base para uma nova prosperidade. A liberalização do potencial virtualmente ilimitado da economia digital seria grandemente promovida por um sistema financeiro pluralista (por exemplo, moedas funcionalmente diferenciadas) e por novas regulamentações para a compensação das invenções.

Plataformas Democráticas

Uma “Wikipedia das Culturas” poderia eventualmente ajudar a coordenar várias atividades em um mundo altamente diversificado e torná-las compatíveis entre si. Isso tornaria explícitos os princípios de sucesso, em sua maioria implícitos, das culturas do mundo, para que pudessem ser combinados de novas maneiras. Um “Projeto Genoma Cultural” como este também seria um tipo de projeto de paz, porque iria aumentar a conscientização pública para o valor da diversidade sociocultural. As empresas globais sabem há muito tempo que as equipes culturalmente diversas e multidisciplinares são mais bem-sucedidas do que as homogêneas.

No entanto, o quadro necessário para agrupar conhecimento de maneira eficiente e idéias de muitas pessoas para criar inteligência coletiva ainda está em falta em muitos lugares. Para mudar isso, o fornecimento de plataformas de deliberação online seria muito útil. Eles também poderiam criar o quadro necessário para realizar uma democracia digital melhorada, com maiores oportunidades de participação para os cidadãos. Isto é importante, porque muitos dos problemas com que o mundo hoje se defronta só poderão ser geridos por meio de contribuições da sociedade civil.

Referências:

ACLU: Orwellian Citizen Score, China’s credit score system, is a warning for Americans, http://www.computerworld.com/article/2990203/security/aclu-orwellian-citizen-score-chinas-credit-score-system-is-a-warning-for-americans.html

Big data, meet Big Brother: China invents the digital totalitarian state. The worrying implications of its social-credit project. The Economist (December 17, 2016).

Harris, S. The Social Laboratory, Foreign Policy (29 July 2014), http://foreignpolicy.com/2014/07/29/the-social-laboratory/

Tong, V.J.C. Predicting how people think and behave, International Innovation, http://www.internationalinnovation.com/predicting-how-people-think-and-behave/

Volodymyr, M., Kavukcuoglu, K., Silver, D., et al.: Human-level control through deep reinforcement learning. In: Nature, 518, S. 529-533, 2015.

Frey, B. S. und Gallus, J.: Beneficial and Exploitative Nudges. In: Economic Analysis of Law in European Legal Scholarship. Springer, 2015.

Gigerenzer, G.: On the Supposed Evidence for Libertarian Paternalism. In: Review of Philosophy and Psychology 6(3), S. 361-383, 2015.

Grassegger, H. and Krogerus, M. Ich habe nur gezeigt, dass es die Bombe gibt [I have only shown the bomb exists]. Das Magazin (3. Dezember 2016) https://www.dasmagazin.ch/2016/12/03/ich-habe-nur-gezeigt-dass-es-die-bombe-gibt/

Hafen, E., Kossmann, D. und Brand, A.: Health data cooperatives – citizen empowerment. In: Methods of Information in Medicine 53(2), S. 82–86, 2014.

Helbing, D.: The Automation of Society Is Next: How to Survive the Digital Revolution. CreateSpace, 2015.

Helbing, D.: Thinking Ahead – Essays on Big Data, Digital Revolution, and Participatory Market Society. Springer, 2015.

Helbing, D. und Pournaras, E.: Build Digital Democracy. In: Nature 527, S. 33-34, 2015.

van den Hoven, J., Vermaas, P.E. und van den Poel, I.: Handbook of Ethics, Values and Technological Design. Springer, 2015.

Zicari, R. und Zwitter, A.: Data for Humanity: An Open Letter. Frankfurt Big Data Lab, 13.07.2015. Zwitter, A.: Big Data Ethics. In: Big Data & Society 1(2), 2014.

Figura 1: Crescimento Digital Fonte: Dirk Helbing

Graças ao Big Data, agora podemos tomar melhores decisões baseadas em evidências. No entanto, o princípio do controle de cima para baixo fracassa cada vez mais, uma vez que a complexidade da sociedade cresce de forma explosiva à medida que vamos trabalhando em rede no nosso mundo. As abordagens de controle distribuídas se tornarão cada vez mais importantes. Só através da inteligência colectiva será possível encontrar soluções adequadas para os desafios da complexidade do nosso mundo.

Figure 2: Encruzilhadas digitais. Fonte: Dirk Helbing

Nossa sociedade se encontra em uma encruzilhada: se até o mesmo os mais poderosos algoritmos fossem controlados por alguns poucos tomadores de decisão e reduzirem nossa auto-determinação, nós iremos regredir para o Feudalismo 2.0, já que importantes realizações históricas seriam perdidas. Agora, no entanto, nós temos a chance de escolher o caminho para a democracia digital ou democracia 2.0, o que poderá beneficiar a todos nós (see also https://vimeo.com/147442522 ).

Holofotes sobre a China: É isso que uma sociedade do futuro parece?

Como o controle comportamental e social pode impactar nossas vidas? O conceito de uma ’Pontuação de cidadão’, que agora está sendo implementado na China, nos dá uma idéia. Lá, todos os cidadãos são classificados em uma escala de classificação unidimensional. Tudo o que eles fazem dá mais ou menos pontos. Isto não se destina apenas à vigilância em massa. A pontuação depende dos cliques de um indivíduo na Internet e da sua conduta politicamente correta ou não, e determina suas condições de crédito, seu acesso a determinados empregos e vistos de viagem. Portanto, a ’Pontuação de Cidadão’ se trata de controle comportamental e social. Mesmo o comportamento de amigos e conhecidos afeta esse escore, isto é, o princípio da responsabilidade do clã também é aplicado: todo mundo se torna ao mesmo tempo um guardião da virtude e um tipo de informante espião, ao mesmo tempo. Pensadores heterodoxos são isolados. Se houver princípios similares a serem difundidos em países democráticos, se torna irrelevante se é o Estado ou empresas influentes que estabelecem as regras. Em ambos os casos, os pilares da democracia estariam diretamente ameaçados:

- O rastreamento e a mensuração de todas as atividades que deixam traços digitais criaria um cidadão vulnerável, cuja dignidade humana e privacidade seriam progressivamente prejudicada.

- As decisões não seriam mais livres, porque uma escolha errada da perspectiva do governo ou da empresa que definisse os critérios de pontos do sistema teria consequências negativas. A autonomia do indivíduo seria, em princípio, abolida.

- Cada pequeno erro seria punido e ninguém seria insuspeito. O princípio da presunção de inocência tornaria-se obsoleto. Policiamento Preventivo poderia até levar a punição por violações que não aconteceram, mas que são apenas esperadas que venham a ocorrer.

- Como os algoritmos subjacentes não podem operar completamente livres de erros, o princípio de equidade e justiça seria substituído por um novo tipo de arbitrariedade, contra a qual as pessoas mal conseguiriam se defender.

- Se as metas individuais fossem estabelecidas externamente, a possibilidade de autodesenvolvimento individual seria eliminada e, portanto, o pluralismo democrático também.

- A cultura local e as normas sociais não seriam mais a base de um comportamento apropriado e dependente da situação.

- O controle da sociedade com uma função-objetivo unidimensional levaria a mais conflitos e, portanto, a uma perda de segurança. Seria esperada uma séria instabilidade, como vimos no nosso sistema financeiro.

Tal controle da sociedade se desviaria dos cidadãos auto-responsáveis para os indivíduos como subordinados, levando a um feudalismo 2.0. Isto é diametralmente oposto aos valores democráticos. É, portanto, o momento para um Iluminismo 2.0, que alimentaria uma Democracia 2.0, baseada na autodeterminação digital. Isso requer tecnologias democráticas: sistemas de informação, que são compatíveis com os princípios democráticos – caso contrário eles vão destruir a nossa sociedade.

“BIG NUDGING” – MAL-PROJETADO PARA RESOLUÇÃO DE PROBLEMAS

Aqueles que possuem grandes quantidades de dados podem manipular as pessoas de maneiras sutis. Mas mesmo os decisores benevolentes podem fazer mais coisas erradas do que certas, diz Dirk Helbing.

Os defensores da Nudging argumentam que as pessoas não tomam decisões ótimas e é, portanto, necessário ajudá-las. Esta escola de pensamento é conhecida como paternalismo. No entanto, Nudging não escolhe o caminho de informar e persuadir as pessoas. Explora, ao contrário, as fraquezas psicológicas para nos levar a certos comportamentos, isto é, somos enganados. A escola científica subjacente a esta abordagem é chamada de “behaviorismo”, que é na verdade muito ultrapassada.

Décadas atrás, Burrhus Frederic Skinner condicionou ratos, pombos e cães por recompensas e castigos (por exemplo, alimentando-os ou aplicando choques elétricos dolorosos). Hoje se tenta condicionar as pessoas de maneira similar. Em vez de em uma caixa de Skinner, estamos vivendo em uma “bolha de filtro”: com informações personalizadas nosso pensamento está sendo dirigido. Com preços personalizados, podemos ser até punidos ou recompensados, por exemplo, por cliques (não desejados) na Internet. A combinação de Nudging com Big Data, portanto, levou a uma nova forma de Nudging que podemos chamar de “Big Nudging”. A crescente quantidade de informações pessoais sobre nós, que muitas vezes é coletada sem o nosso consentimento, revela o que pensamos, como nos sentimos e como podemos ser manipulados. Esta informação privilegiada é explorada para nos manipular para fazer escolhas que de outra forma não faria, para comprar alguns produtos com preço excessivo ou aqueles que não precisamos, ou talvez para dar o nosso voto a um determinado partido político.

No entanto, Big Nudging não é adequado para resolver muitos de nossos problemas. Isto é particularmente verdadeiro para os desafios relacionados à complexidade do nosso mundo. Embora 90 países já usem Nudging, isso não reduziu nossos problemas sociais – pelo contrário. O aquecimento global continua avançando. A paz mundial é frágil e o terrorismo está em ascensão. Cibercrime explode, e também a crise econômica e da dívida não é resolvido em muitos países.

Também não há solução para a ineficiência dos mercados financeiros, como admitiu recentemente o guru do Nudging Richard Thaler. Na sua opinião, se o Estado controlasse os mercados financeiros, isso agravaria o problema. Mas por que alguém deve então controlar a nossa sociedade de um modo de cima para baixo, o que é ainda mais complexo do que um mercado financeiro? A sociedade não é uma máquina, e sistemas complexos não podem ser dirigidos como um carro. Isso pode ser entendido discutindo outro sistema complexo: nossos corpos. Para curar doenças, é preciso tomar o remédio certo no momento certo na dose certa. Muitos tratamentos também têm sérios efeitos colaterais e de interação. O mesmo, naturalmente, é esperado para se aplicar às intervenções sociais por Big Nudging. Muitas vezes não é claro com antecedência o que seria bom ou ruim para a sociedade. 60 por cento dos resultados científicos em psicologia não são reproduzíveis. Portanto, as chances são de causar mais mal do que bem por Big Nudging.

Além disso, não há nenhuma medida, que seja boa para todas as pessoas. Por exemplo, nas últimas décadas vimos avisos de alimentos mudando o tempo todo. Muitas pessoas também sofrem de intolerâncias alimentares, que podem até ser fatais. Os exames em massa para certos tipos de câncer e outras doenças estão sendo vistos de forma bastante crítica, porque os efeitos colaterais de diagnósticos errôneos freqüentemente superam os benefícios. Portanto, se um decidiu usar Big Nudging, uma sólida base científica, transparência, avaliação ética e controle democrático seria realmente crucial. As medidas tomadas teriam de garantir melhorias estatisticamente significativas e os efeitos colaterais teriam de ser aceitáveis. Os utilizadores devem ser informados (por analogia com um folheto médico), e as pessoas tratadas terão de ter a última palavra.

Além disso, aplicar uma única e mesma medida a toda a população não seria bom. Contudo, muito pouco se sabe para tomar medidas individuais apropriadas. Não só é importante para a sociedade aplicar diferentes tratamentos, a fim de manter a diversidade, mas as correlações (sobre o que medida a tomar em que determinado contexto) também. Para o funcionamento da sociedade, é essencial que as pessoas apliquem papéis diferentes, que são adequados à respectiva situação em que estão. Big Nudging está longe de ser capaz de entregar isto.

A personalização atual de Big-Data-based cria novos problemas, como discriminação. Por exemplo, se fizermos taxas de seguro de saúde dependentes de certas dietas, então judeus, muçulmanos e cristãos, mulheres e homens terão que pagar taxas diferentes. Assim, um monte de novos problemas estarão surgindo ..

Richard Thaler, portanto, não está se tornando repetitivo ao enfatizar que Nudging só deve ser usado de forma benéfica. Como um excelente exemplo de como usar Nudging, ele menciona um sistema de orientação de rota baseado em GPS. Esse modelo, no entanto, pode ser ativado e desativado pelo utilizador. O usuário também especifica a respectiva meta. O assistente digital oferece então várias alternativas entre as quais o usuário pode escolher livremente. Depois disso, o assistente digital apóia o usuário o melhor possível para alcançar a meta e tomar melhores decisões. Esta seria certamente a abordagem certa para melhorar os comportamentos das pessoas, mas hoje o espírito de Big Nudging é bastante diferente.

O DIREITO À AUTO-DETERMINAÇÃO POR MEIO DO DIREITO À CÓPIA

A Europa deve garantir aos cidadãos o direito a uma cópia digital de todos os dados sobre eles (direito à cópia), diz Ernst Hafen. Um primeiro passo para a democracia de dados seria estabelecer bancos cooperativos para dados pessoais que são de propriedade dos cidadãos e não por acionistas corporativos.

A Medicina pode lucrar com dados de saúde. No entanto, o acesso aos dados pessoais deve ser controlado pelas as pessoas (os próprios dados). O “Direito à Cópia” constitui a base para tal controle.

Na Europa, gostamos de salientar que vivemos em sociedades livres e democráticas. Nós, no entanto, nos tornamos dependentes quase inconscientemente de empresas multinacionais de internet cujos serviços gratuitos pagamos com nossos próprios dados. Os dados pessoais – que às vezes é conhecido como uma “nova classe de ativos” ou o petróleo do século 21 – é muito procurado. No entanto, até agora ninguém conseguiu extrair o máximo de uso de dados pessoais porque ele está em muitos conjuntos de dados diferentes. O Google e o Facebook podem saber mais sobre a nossa saúde do que o nosso médico, mas mesmo essas empresas não conseguem coligir todos os nossos dados, porque eles não têm acesso a nossos históricos médicos, recibos de compras ou informações sobre nossa composição genômica. Em contraste com outros ativos, os dados podem ser copiados com quase nenhum custo associado. Toda pessoa deve ter o direito de obter uma cópia de todos os seus dados pessoais. Desta forma, eles podem controlar o uso e agregação de seus dados e decidir se irão dar acesso a amigos, outro médico ou a comunidade científica.

O surgimento de sensores móveis de saúde e aplicativos significa que os pacientes podem contribuir insights médicos significativos. Ao registrar sua saúde física em seus smartphones, como indicadores médicos e os efeitos colaterais dos medicamentos, eles fornecem dados importantes que permitem observar como os tratamentos são aplicados, avaliar tecnologias de saúde e conduzir a medicina baseada em evidências em geral. É também uma obrigação moral dar aos cidadãos o acesso a cópias de seus dados e permitir que eles participem na pesquisa médica, porque ele vai salvar vidas e tornar os cuidados de saúde mais acessíveis.

Os países europeus devem prender a autodeterminação digital de seus cidadãos, consagrando o “Direito à Cópia” em suas constituições, como foi proposto na Suíça. Desta forma, os cidadãos podem usar seus dados para desempenhar um papel ativo na economia global de dados. Se eles puderem armazenar cópias de seus dados em instituições sem fins lucrativos, controladas pelos cidadãos e cooperativas, uma grande parcela do valor econômico dos dados pessoais pode ser devolvida à sociedade. As instituições cooperativas atuariam como trustees na administração dos dados de seus membros. Isto resultaria na democratização do mercado de dados pessoais e no fim da dependência digital.

SOCIEDADE DEMOCRÁTICA DIGITAL

Os cidadãos devem ser autorizados a participar activamente

Para lidar com a tecnologia futura de forma responsável, é necessário que cada um de nós possa participar do processo de tomada de decisão, argumenta Bruno S. Frey, da Universidade de Basileia

Como promover a inovação responsável de forma eficaz? Os apelos ao público têm pouco ou nenhum efeito se as instituições ou regras que moldam as interações humanas não forem projetadas para incentivar e permitir que as pessoas atendam a esses pedidos.

Vários tipos de instituições devem ser considerados. Mais importante ainda, a sociedade deve ser descentralizada, seguindo o princípio da subsidiariedade. Três dimensões importam.

- A descentralização espacial consiste em um federalismo vibrante. As províncias, regiões e comunas devem ter autonomia suficiente. Em grande medida, devem poder fixar as suas próprias taxas de imposto e regular as suas próprias despesas públicas.

- Também é desejável a descentralização funcional de acordo com a área de despesa pública (por exemplo, educação, saúde, meio ambiente, abastecimento de água, tráfego, cultura etc.). Este conceito foi desenvolvido através da proposta da FOCJ, ou “Jurisdições funcionais, sobrepostas e concorrentes”.

- Descentralização política relativa à divisão do poder entre o executivo (governo), legislativo (parlamento) e os tribunais. Os meios de comunicação públicos e o mundo académico devem constituir pilares adicionais.

Estes tipos de descentralização continuarão a ser de grande importância na sociedade digital do futuro.

Além disso, os cidadãos devem ter a oportunidade de participar diretamente na tomada de decisões sobre questões específicas por meio de referendos populares. No discurso anterior a esse referendo, todos os argumentos relevantes devem ser apresentados e colocados de forma organizada. As várias propostas sobre como resolver um problema particular devem ser comparadas e reduzidas àquelas que parecem ser mais promissoras, e integradas, tanto quanto possível, durante um processo de mediação. Por último, é necessário realizar um referendo que sirva para identificar a solução mais viável para as condições locais (viável no sentido de que goza de uma ampla gama de apoio no eleitorado).

Hoje em dia, ferramentas de deliberação online podem apoiar eficientemente esses processos. Isto torna possível considerar uma gama maior e mais diversificada de idéias e conhecimentos, aproveitando a “inteligência coletiva” para produzir melhores propostas de políticas.

Outra forma de implementar as dez propostas seria criar novas instituições nao-ortodoxas. Por exemplo, poderia ser tornado obrigatório para cada organismo oficial assumir “um advogado do diabo”. Este pensador paralelo seria encarregado de desenvolver contra-argumentos e alternativas a cada proposta. Isto reduziria a tendência para pensar ao longo das linhas de “correção política” e abordagens não convencionais para o problema também seria considerado.

Outra medida não ortodoxa seria escolher entre as alternativas consideradas razoáveis durante o processo discursivo, utilizando mecanismos aleatórios de tomada de decisão. Tal abordagem aumenta a possibilidade de que propostas e idéias não convencionais e geralmente desconsideradas sejam integradas na sociedade digital do futuro.

Bruno S. Frey

Bruno Frey (* 1941) é economista acadêmico e Professor Visitante Permanente na Universidade de Basileia, onde dirige o Centro de Pesquisa em Economia e Bem-Estar (CREW). Ele também é Diretor de Pesquisa do Centro de Pesquisa em Economia, Gestão e Artes (CREMA), em Zurique.

TECNOLOGIAS DEMOCRÁTICAS E INOVAÇÃO RESPONSÁVEL

Quando a tecnologia determina como vemos o mundo, há uma ameaça de uso indevido e decepção. Assim, a inovação deve refletir nossos valores, argumenta Jeroen van den Hoven.

A Alemanha foi recentemente abalada por um escândalo industrial de proporções globais. As revelações levaram à demissão do CEO de um dos maiores fabricantes de automóveis, uma grave perda de confiança do consumidor, uma queda dramática no preço das ações e danos econômicos para toda a indústria automobilística. Houve mesmo falas sobre danos graves para a marca “Made in Germany”. Os pagamentos de compensação serão feitos na faixa de bilhões de euros.

O cenário do escândalo foi uma situação em que a VW e outros fabricantes de automóveis usaram software manipulador que poderia detectar as condições sob as quais a conformidade ambiental de um veículo seria testada. O algoritmo de software alterou o comportamento do motor de modo a emitir menos poluentes nos gases de escape nas condições em que o teste seria conduzido em circunstâncias normais. Desta forma, enganou o procedimento de teste. A redução total das emissões ocorreu apenas durante os testes, mas não em uso normal.

No século XXI, precisamos urgentemente abordar a questão de como podemos implementar padrões éticos tecnologicamente.

Da mesma forma, algoritmos, código de computador, software, modelos e dados vão cada vez mais determinar o que vemos na sociedade digital, e quais são as escolhas no que diz respeito ao seguro de saúde, finanças e política. Isso traz novos riscos para a economia e para a sociedade. Em particular, existe o perigo de engodo.

Assim, é importante entender que nossos valores são incorporados nas coisas que criamos. Caso contrário, o design tecnológico do futuro determinará a forma da nossa sociedade (“código é lei”). Se esses valores forem egoístas, discriminatórios ou contrários aos ideais de liberdade e privacidade pessoal, isso prejudicará nossa sociedade. Assim, no século XXI devemos urgentemente abordar a questão de como podemos implementar tecnicamente padrões éticos. O desafio nos convida a “desenvolver para gerar valor”.

Se não temos a motivação para desenvolver as ferramentas tecnológicas, as ciências e as instituições necessárias para alinhar o mundo digital com os nossos valores comuns, o futuro parece muito sombrio. Felizmente, a União Europeia tem investido num extenso programa de investigação e desenvolvimento para a inovação responsável. Além disso, os países da UE que aprovaram as declarações de Lund e Roma salientaram que a inovação deve ser levada a cabo de forma responsável. Entre outras coisas, isso significa que a inovação deve ser direcionada ao desenvolvimento de soluções inteligentes para os problemas sociais, que podem harmonizar valores como eficiência, segurança e sustentabilidade. A verdadeira inovação não envolve enganar as pessoas a acreditar que seus carros são sustentáveis e eficientes. A inovação genuína significa criar tecnologias que realmente podem satisfazer esses requisitos.

ENSINO DIGITAL DE RISCO

Tecnologia precisa de usuários que saibam controla-la

Ao invés de deixar tecnologia inteligente diminuir nosso poder cerebral, nós devemos aprender como controla-lo melhor, afirma Gerd Gigerenzer – começando na infância

A revolução digital permite uma ampla gama de possibilidades: milhares de aplicativos, a Internet das Coisas e uma conectividade quase permanente com o mundo. Mas em meio à excitação, uma coisa é certamente esquecível: tecnologia inovadora precisa de usuários competentes que possam controla-lo ao invés de ser controlado por isso.

Três exemplos:

Um dos meus estudantes de doutorado senta em seu computador e parece estar envolvido em escrever sua dissertação. Ao mesmo tempo sua caixa de email está aberta o tempo todo. Ele está de fato esperando para ser interrompido. É fácil reconhecer quantas interrupções ele teve ao longo do dia ao olhar o fluxo de sua escrita.

Um estudante americano escreve mensagens enquanto dirige:

“Quando um texto entra, eu só tenho que olhar, não importa o quê. Felizmente, meu telefone me mostra o texto como um pop-up no início … então eu não tenho que ficar muito olhando enquanto estou dirigindo.” Se, à velocidade de 50 milhas por hora, ela leva apenas 2 segundos para olhar para o seu telefone celular, ela é apenas dirigido 48 metros “cego”. Aquela jovem está arriscando um acidente de carro. Seu telefone inteligente tomou o controle de seu comportamento – como é o caso para os 20 a 30 por cento dos alemães que também texto durante a condução.

Durante as eleições parlamentares na Índia em 2014, a maior eleição democrática do mundo com mais de 800 milhões de potenciais eleitores, havia três candidatos principais: N. Modi, A. Kejriwal e R. Ghandi. Em um estudo, eleitores indecisos poderiam encontrar mais informações sobre esses candidatos usando um motor de busca na Internet. No entanto, os participantes não sabiam que as páginas da web haviam sido manipuladas: para um grupo, mais itens positivos sobre Modi apareciam na primeira página e negativos mais tarde. Os outros grupos experimentaram o mesmo para os outros candidatos. Este e procedimentos de manipulação semelhantes são prática comum na Internet. Estima-se que para os candidatos que aparecem na primeira página graças a tal manipulação, o número de votos que recebem de indecisos eleitores aumenta em 20 pontos percentuais.

Em cada um desses casos, o comportamento humano é controlado pela tecnologia digital. Perder o controle não é nada de novo, mas a revolução digital aumentou a possibilidade de que isso aconteça.

O que podemos fazer? Há três visões concorrentes. Um deles é o techno-paternalismo, que substitui o julgamento humano (falho) por algoritmos. O estudante de doutorado distraído poderia continuar leituras seus e-mails e usar software de tese-escrita; Tudo que ele precisaria fazer é inserir informações-chave sobre o tópico. Esses algoritmos resolveriam o problema irritante dos escândalos de plágio, tornando-os uma ocorrência cotidiana.

Embora ainda no domínio da ficção científica, o julgamento humano já está sendo substituído por programas de computador em muitas áreas. O aplicativo BabyConnect, por exemplo, rastreia o desenvolvimento diário dos bebês – altura, peso, número de vezes que foi amamentado, quantas vezes suas fraldas foram alteradas e muito mais – enquanto os aplicativos mais novos comparam o bebê com os filhos de outros usuários em um ambiente real -time banco de dados. Para os pais, seu bebê torna-se um vetor de dados, e discrepâncias normais muitas vezes causam preocupação desnecessária.

A segunda visão é conhecida como “nudging”. Em vez de deixar o algoritmo fazer todo o trabalho, as pessoas são orientadas para uma determinada direção, muitas vezes sem estar ciente disso. A experiência sobre as eleições na Índia é um exemplo disso. Sabemos que a primeira página dos resultados de pesquisa do Google recebe cerca de 90% de todos os cliques e metade destes são os dois primeiros resultados. Este conhecimento sobre o comportamento humano é aproveitado ao manipular a ordem dos resultados para que os positivos sobre um determinado candidato ou um determinado produto comercial apareçam na primeira página. Em países como a Alemanha, onde buscas na web são dominadas por um motor de busca (Google), isso leva a infinitas possibilidades de influenciar os eleitores. Como o techno-paternalismo, o nudging assume o comando.

Mas há uma terceira possibilidade. Minha visão é a alfabetização de risco, no qual as pessoas são equipadas com as competências necessárias para controlar a mídia em vez de serem controladas por ela. Em geral, a alfabetização de risco preocupa formas informadas de lidar com áreas relacionadas com o risco, como saúde, dinheiro e tecnologias modernas. A alfabetização de risco digital significa ser capaz de tirar proveito das tecnologias digitais sem se tornar dependente ou manipulado por elas. Isso não é tão difícil quanto parece. Meu aluno de doutorado já aprendeu a ligar sua conta de e-mail apenas três vezes por dia, manhã, meio-dia e à noite, para que ele possa trabalhar em sua dissertação sem interrupção constante.

Aprender auto-controle digital precisa começar como uma criança, na escola e também a partir do exemplo estabelecido pelos pais. Alguns paternalistas podem zombar da ideia, afirmando que os humanos não têm inteligência e autodisciplina para se tornarem alfabetizados com o risco. Mas séculos atrás, o mesmo foi dito sobre aprender a ler e escrever – o que a maioria das pessoas em países industrializados pode agora fazer. Da mesma forma, as pessoas podem aprender a lidar com os riscos de forma mais sensata. Para conseguir isso, precisamos repensar radicalmente as estratégias e investir nas pessoas ao invés de substituí-las ou manipulá-las com tecnologias inteligentes. No século XXI, precisamos de menos paternalismo e de cidadãos mais informados, críticos e conscientes do risco. É hora de arrebatar o controle remoto da tecnologia e tomar nossas vidas em nossas próprias mãos.

ÉTICA: GRANDES DADOS PARA O BEM COMUM E PARA A HUMANIDADE

O poder dos dados pode ser usado para bons e maus propósitos. Roberto Zicari e Andrej Zwitter formularam cinco princípios da Ética dos Grandes Dados.

Por Andrej Zwitter e Roberto Zicari

Nos últimos tempos tem havido um número crescente de vozes – desde visionários tecnológicos como Elon Musk (Tesla Motors), até Bill Gates (Microsoft) e Steve Wozniak (Apple) – alertando para os perigos da inteligência artificial. Uma petição contra sistemas automatizados de armas foi assinada por 200 mil pessoas e uma carta aberta recentemente publicada pelo MIT pede uma nova abordagem inclusiva para a futura sociedade digital.

devemos perceber que Big Data, tal como qualquer outra ferramenta, podem ser usados para fins bons e ruins. Neste sentido, é compreensível a decisão do Tribunal de Justiça das Comunidades Europeias contra o Acordo Safe Harbor por razões de direitos humanos.

Os Estados, as organizações internacionais e os atores privados utilizam agora grandes dados numa variedade de domínios. É importante que todos aqueles que lucram com grandes dados estão cientes de sua responsabilidade moral. Por essa razão, foi criada a Iniciativa “Dados para a Humanidade”, com o objetivo de disseminar um código ético de conduta para o grande uso de dados. Esta iniciativa avança cinco princípios éticos fundamentais para grandes usuários de dados:

1. “Não faça mal”. A pegada digital que todos deixam para trás expõe indivíduos, grupos sociais e sociedade como um todo a um certo grau de transparência e vulnerabilidade. Aqueles que têm acesso aos insights proporcionados por grandes dados não devem prejudicar terceiros.

2. Assegurar que os dados sejam utilizados de tal forma que os resultados fomentem a coexistência pacífica da humanidade. A seleção de conteúdo e acesso a dados influencia a visão de mundo de uma sociedade. Coexistência pacífica só é possível se os cientistas de dados estão cientes de sua responsabilidade de fornecer acesso igual e imparcial aos dados.

3. Use dados para ajudar as pessoas necessitadas. Além de ser economicamente benéfico, a inovação na esfera de Big Data também poderia criar valor social adicional. Na era da conectividade global, agora é possível criar ferramentas de dados grandes e inovadoras que poderiam ajudar a apoiar pessoas carentes.

4. Use dados para proteger a natureza e reduzir a poluição do ambiente. Uma das maiores conquistas da grande análise de dados é o desenvolvimento de processos eficientes e efeitos de sinergia. Os grandes dados só podem oferecer um futuro econômico e social sustentável se tais métodos também forem usados para criar e manter um ambiente natural saudável e estável.

5. Utilizar dados para eliminar a discriminação e a intolerância e criar um sistema justo de convivência social. A mídia social criou uma rede social fortalecida. Isto só pode conduzir a uma estabilidade global a longo prazo se for construída com base nos princípios do que é correto, da igualdade e da justiça.

Para concluir, gostaríamos também de chamar a atenção para o quanto as novas possibilidades oferecidas pelo Big Data podem levar a um futuro melhor: “À medida que mais dados se tornem menos onerosos e a tecnologia quebre barreiras à aquisição e análise, a oportunidade de fornecer informações Isso pode ser chamado de “bem comum” desafio para grandes dados. ” (Jake Porway, DataKind). No final, é importante entender a questão do Big Data como uma oportunidade para fazer o bem e como uma esperança para um futuro melhor.

MEDIÇÃO, ANÁLISE, OPTIMIZAÇÃO: QUANDO AS MÁQUINAS INTELIGENTES TOMAM O CONTROLE SOCIETAL

Na era digital, as máquinas dirigem a vida cotidiana em uma extensão considerável já. Devemos, portanto, pensar duas vezes antes de compartilhar nossos dados pessoais, diz a especialista Yvonne Hofstetter

Se Norbert Wiener (1894-1964) tivesse experimentado a era digital, para ele teria sido a terra da abundância. “A cibernética é a ciência da informação e do controle, independentemente de o objetivo do controle ser uma máquina ou um organismo vivo”, explicou o fundador da Cibernética em Hannover, na Alemanha, em 1960. Na história, o mundo nunca produziu uma quantidade de dados e informações como o faz hoje.

Cibernética, uma ciência que sempre buscou ressaltar sua própria importância, faz uma forte afirmação: “Tudo pode ser controlado.” Durante o século 20, tanto as forças armadas dos EUA e a União Soviética aplicada Cybernetics para controlar a sua raça de armas. A OTAN implantou os chamados sistemas C3I (Comando, Controle, Comunicação e Informação), um termo para infra-estrutura militar que se inclina lingüisticamente para o livro de Wiener sobre Cibernética: Ou Controle e Comunicação no Animal e na Máquina, publicado em 1948. O controle se refere ao controle de máquinas, bem como de indivíduos ou sistemas sociais inteiros como alianças militares, mercados financeiros ou, apontando para o século XXI, até mesmo o eleitorado. Sua principal premissa: manter o mundo sob vigilância para coletar dados. Conectando pessoas e coisas à Internet de Tudo é uma maneira perfeita de obter os dados de massa necessários como entrada para estratégias de controle cibernético.

Com a Cibernética, Wiener propôs um novo conceito científico: o feedback em malha fechada. Comentários – ex. Os gostos que damos, os comentários on-line que fazemos – é um conceito importante de digitalização, também. Isso significa que a digitalização é a implementação mais perfeita da Cibernética? Quando usamos dispositivos inteligentes, estamos criando um fluxo de dados incessante que divulga nossas intenções, posição geográfica ou ambiente social. Enquanto nos comunicamos mais irrefletidamente do que nunca online, em segundo plano, um ecossistema de inteligência artificial está evoluindo. Hoje, a inteligência artificial é a única tecnologia capaz de nos perfilar e tirar conclusões sobre o nosso comportamento futuro.

Uma estratégia de controle automatizada, usualmente uma máquina de aprendizado, analisa nossa situação atual e, em seguida, calcula um estímulo que deve nos aproximar de um estado “ótimo” mais desejável. Cada vez mais, tais controladores governam nossa vida diária. Como assistentes digitais, eles nos ajudam a tomar decisões no vasto oceano de opcionalidade e intimidando a incerteza. Mesmo o Google Search é uma estratégia de controle. Ao digitar uma palavra-chave, um usuário revela suas intenções. O motor de busca do Google, por sua vez, não apenas apresentará uma lista com os melhores hits, mas uma lista de links que incorpora o valor mais alto (financeiro), mais para a empresa do que para o usuário. Fazendo dessa forma, ou seja, listando ofertas corporativas no topo dos resultados de pesquisa, o Google controla os próximos cliques do usuário. Isto, defende a União Europeia, é um mau uso.

Mas há alguma saída? Sim, se desligarmos do circuito cibernético. Basta parar de responder a um estímulo digital. A cibernética falhará, se a contraparte controlável sair do loop. No entanto, estamos livres para devemos uma resposta a um controlador digital. No entanto, à medida que a digitalização se intensifica, em breve não teremos mais escolha. Por isso, somos chamados a lutar por nossos direitos de liberdade – novamente durante a era digital e em particular no surgimento de máquinas inteligentes.

Para Norbert Wiener (1894-1964), a era digital seria um paraíso. “A cibernética é a ciência da informação e do controle, independentemente de uma máquina ou de um organismo vivo estar sendo controlado”, disse o fundador da cibernética em Hannover, na Alemanha, em 1960.

A cibernética, uma ciência que afirma a importância ubíqua faz uma promessa forte: “Tudo é controlável”. Durante o século 20, tanto as forças armadas dos EUA e a União Soviética aplicaram a cibernética para controlar a corrida armamentista. A OTAN implantou os chamados sistemas C3I (Comando, Controle, Comunicação e Informação), um termo para infra-estrutura militar que se inclina linguisticamente no livro de Wiener intitulado Cybernetics: Ou Controle e Comunicação no Animal e na Máquina publicado em 1948. O controle refere-se ao Controle de máquinas, bem como de indivíduos ou sistemas sociais inteiros como alianças militares, a OTAN e o Pacto de Varsóvia. Suas necessidades básicas são: Integrar, coletar dados e comunicar. Conectando pessoas e coisas à Internet de Tudo é uma maneira perfeita de obter os dados necessários como entrada de estratégias de controle cibernético.

Com a cibernética, propôs-se um novo conceito científico: o feedback em malha fechada. Feedback – como os gostos que damos ou os comentários on-line que fazemos – é outro conceito importante relacionado à digitalização. Isso significa que a digitalização é a implementação mais perfeita da cibernética? Quando usamos dispositivos inteligentes, criamos um fluxo de dados interminável que divulga nossas intenções, geolocalização ou ambiente social. Enquanto nos comunicamos mais irrefletidamente do que nunca online, em segundo plano, um ecossistema de inteligência artificial (AI) está evoluindo. Hoje, a AI é a única tecnologia capaz de perfilar-nos e tirar conclusões sobre o nosso comportamento futuro.

Uma estratégia de controle automatizada, geralmente uma máquina de aprendizado, analisa nosso estado atual e calcula um estímulo que deve nos aproximar de um estado “ótimo” mais desejável. Cada vez mais, tais controladores governam nossa vida diária. Esses assistentes digitais nos ajudam a tomar decisões entre o vasto oceano de opções e intimidando a incerteza. Mesmo o Google Search é uma estratégia de controle. Ao digitar uma palavra-chave, um usuário revela suas intenções. O mecanismo de busca do Google, por sua vez, apresenta não apenas uma lista dos melhores hits, mas também uma lista de links classificados de acordo com seu valor (financeiro) para a empresa, e não para o usuário. Ao listar ofertas corporativas no topo dos resultados de pesquisa, o Google controla os próximos cliques do usuário. Isso é um mau uso do monopólio do Google, argumenta a União Européia.

Mas há alguma saída? Sim, se nos desligarmos do circuito cibernético e simplesmente deixarmos de responder ao estímulo digital. A cibernética falhará, se a contraparte controlável sair do loop. Devemos permanecer discretos e frugais com os nossos dados, mesmo que seja difícil. No entanto, à medida que a digitalização se intensifica, em breve não haverá mais escolhas. Por isso, somos chamados a lutar mais uma vez pela nossa liberdade na era digital, particularmente contra a ascensão de máquinas inteligentes.

0 comentários